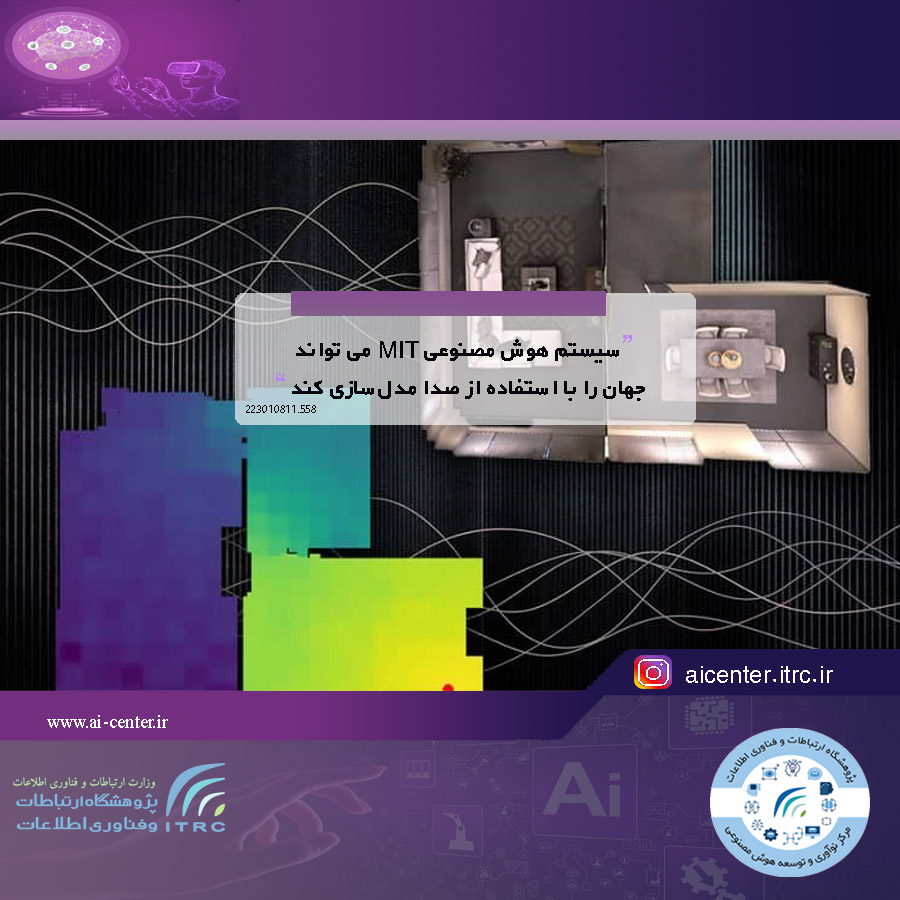

بینایی کامپیوتر زمینهای است که در چند دهه گذشته بسیار مورد تحقیق قرار گرفته است، و در درجه اول به دلیل کاربردهای فوری و آشکار آن در ساخت وسایل نقلیه خودران و سایر ابزارهایی که میتوانند جهان را مانند انسان ببینند. با این حال، یکی از حوزههایی که تا همین اواخر شاهد این سطح از تحقیقات نبوده، استفاده از صدا به جای بینایی برای مدلسازی یک محیط است.

اکنون، محققان موسسه فناوری ماساچوست (MIT) یک مقاله تحقیقاتی در رابطه با ساخت یک مدل یادگیری ماشینی (ML) آموزش دیده در این حوزه نوشته اند. یک پست وبلاگ در وب سایت MIT News توضیح داده که محققان MIT و آزمایشگاه هوش مصنوعی MIT-IBM Watson برای ساختن یک مدل ML که از آکوستیک فضایی برای دیدن و مدل سازی محیط استفاده می کند، همکاری کرده اند.

به بیان ساده، این مدل نقشه برداری یک محیط را با فهمیدن اینکه چگونه شنونده صدایی را که از یک نقطه منشأ می گیرد و به موقعیت های مختلف منتشر می شود بشنود، امکان پذیر می کند. مزایای زیادی برای این تکنیک وجود دارد زیرا امکان تعیین هندسه سه بعدی زیربنایی اشیاء محیطی را با استفاده از صدا فراهم می کند.

سپس می تواند تصاویر دقیقی را برای بازسازی محیط ارائه دهد. برنامه های کاربردی بالقوه شامل واقعیت مجازی و واقعیت افزوده، به همراه عوامل هوش مصنوعی تقویت شده است تا بتوانند از صدا و بینایی برای تجسم بهتر محیط خود استفاده کنند. به عنوان مثال، یک ربات کاوشگر زیر آب می تواند از آکوستیک برای تعیین بهتر مکان اشیاء خاص در مقایسه با بینایی کامپیوتری استفاده کند.

محققان تاکید کرده اند که ساخت این مدل ML بر اساس صدا بسیار پیچیده تر از مدل مبتنی بر بینایی کامپیوتری است. این به این دلیل است که مدلهای بینایی کامپیوتری از خاصیتی به نام سازگاری فتومتریک استفاده میکنند، به این معنی که وقتی یک شی از زوایای مختلف مشاهده میشود تقریباً یکسان به نظر میرسد. این در مورد صدا صدق نمی کند زیرا بسته به موقعیت مکانی شما و سایر موانع، آنچه از منبع می شنوید ممکن است بسیار متغیر باشد.

برای مقابله با این مشکل، محققان از دو ویژگی دیگر به نامهای متقابل و هندسه محلی استفاده کردند. اولی اساساً به این معنی است که حتی اگر مکان گوینده و شنونده را عوض کنید، صدا دقیقاً یکسان خواهد بود. در همین حال، نقشهبرداری هندسه محلی شامل ترکیب دوطرفه در یک میدان صوتی عصبی (NAF) برای گرفتن اشیاء و سایر اجزای معماری بود.

اکنون، محققان موسسه فناوری ماساچوست (MIT) یک مقاله تحقیقاتی در رابطه با ساخت یک مدل یادگیری ماشینی (ML) آموزش دیده در این حوزه نوشته اند. یک پست وبلاگ در وب سایت MIT News توضیح داده که محققان MIT و آزمایشگاه هوش مصنوعی MIT-IBM Watson برای ساختن یک مدل ML که از آکوستیک فضایی برای دیدن و مدل سازی محیط استفاده می کند، همکاری کرده اند.

به بیان ساده، این مدل نقشه برداری یک محیط را با فهمیدن اینکه چگونه شنونده صدایی را که از یک نقطه منشأ می گیرد و به موقعیت های مختلف منتشر می شود بشنود، امکان پذیر می کند. مزایای زیادی برای این تکنیک وجود دارد زیرا امکان تعیین هندسه سه بعدی زیربنایی اشیاء محیطی را با استفاده از صدا فراهم می کند.

سپس می تواند تصاویر دقیقی را برای بازسازی محیط ارائه دهد. برنامه های کاربردی بالقوه شامل واقعیت مجازی و واقعیت افزوده، به همراه عوامل هوش مصنوعی تقویت شده است تا بتوانند از صدا و بینایی برای تجسم بهتر محیط خود استفاده کنند. به عنوان مثال، یک ربات کاوشگر زیر آب می تواند از آکوستیک برای تعیین بهتر مکان اشیاء خاص در مقایسه با بینایی کامپیوتری استفاده کند.

محققان تاکید کرده اند که ساخت این مدل ML بر اساس صدا بسیار پیچیده تر از مدل مبتنی بر بینایی کامپیوتری است. این به این دلیل است که مدلهای بینایی کامپیوتری از خاصیتی به نام سازگاری فتومتریک استفاده میکنند، به این معنی که وقتی یک شی از زوایای مختلف مشاهده میشود تقریباً یکسان به نظر میرسد. این در مورد صدا صدق نمی کند زیرا بسته به موقعیت مکانی شما و سایر موانع، آنچه از منبع می شنوید ممکن است بسیار متغیر باشد.

برای مقابله با این مشکل، محققان از دو ویژگی دیگر به نامهای متقابل و هندسه محلی استفاده کردند. اولی اساساً به این معنی است که حتی اگر مکان گوینده و شنونده را عوض کنید، صدا دقیقاً یکسان خواهد بود. در همین حال، نقشهبرداری هندسه محلی شامل ترکیب دوطرفه در یک میدان صوتی عصبی (NAF) برای گرفتن اشیاء و سایر اجزای معماری بود.

کد خبر ۲۲۳۰۱۰۸۱۱.۵۵۸